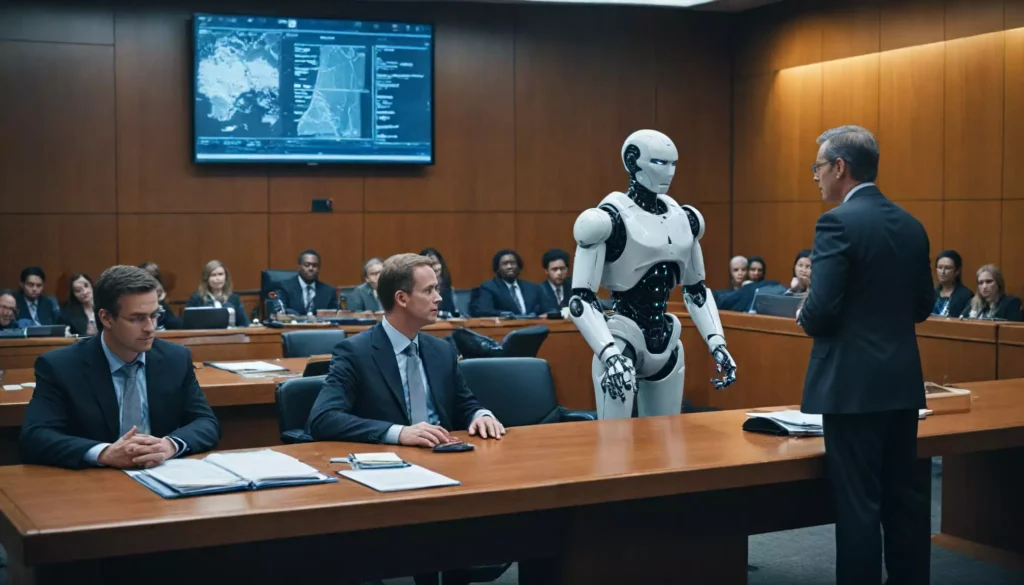

Wprowadzenie: AI a dostęp do wymiaru sprawiedliwości

Szybki rozwój sztucznej inteligencji wpływa na wszystkie obszary życia publicznego, w tym na funkcjonowanie systemu prawnego. Coraz częściej rozważane są rozwiązania, które mogą zwiększyć dostęp do wymiaru sprawiedliwości poprzez automatyzację procesów, analizę dokumentów i wspomaganie decyzji prawnych.

Warto przy tym rozróżnić potencjalne korzyści od ryzyk. Z jednej strony AI może obniżyć koszty i skrócić czas postępowań, z drugiej — wprowadzić problemy związane z brakiem przejrzystości i odpowiedzialnością za błędne decyzje. Ten artykuł omawia główne szanse i zagrożenia oraz proponuje praktyczne rekomendacje.

Szanse: efektywność, dostępność i automatyzacja

Zastosowanie algorytmów do analizy akt sprawy, wyszukiwania orzecznictwa czy przygotowywania projektów pism procesowych może znacząco zwiększyć efektywność obsługi prawnej. Dzięki temu osoby o niższych dochodach mogą zyskać łatwiejszy dostęp do rzetelnej informacji prawnej, co przekłada się bezpośrednio na poprawę dostępności usług prawnych.

Automatyzacja rutynowych zadań, takich jak triaż spraw, klasyfikacja dokumentów czy wstępne wyliczenia odszkodowań, odciąża prawników i sądy, pozwalając skupić zasoby na sprawach wymagających ludzkiej oceny. Automatyzacja może też przyczynić się do skrócenia terminów postępowań i ograniczenia backlogu w sądach.

Zagrożenia: stronniczość, brak przejrzystości i ryzyko błędu

Jednym z największych zagrożeń jest występowanie bias w danych treningowych, co może prowadzić do dyskryminujących wyników. Jeżeli model uczy się na historycznych orzeczeniach pełnych systemowych uprzedzeń, może je utrwalać i powielać, zagrażając bezstronności wymiaru sprawiedliwości.

Równie istotna jest kwestia przejrzystości — wiele zaawansowanych modeli działa jak „czarna skrzynka”, a ich decyzje trudno wytłumaczyć. Brak zrozumiałości powoduje, że strony postępowań nie mogą skutecznie kwestionować wyników generowanych przez AI, co osłabia praworządność i zaufanie publiczne.

Aspekty prawne i etyczne

Wprowadzenie AI do systemu prawnego wymaga jasnych ram prawnych regulujących odpowiedzialność, audytowalność i standardy jakości. Należy określić, kto ponosi odpowiedzialność za błędne rekomendacje — twórca oprogramowania, dostawca usługi czy instytucja korzystająca z narzędzia.

Aspekty etyczne obejmują ochronę praw człowieka, prawo do równego traktowania i prawo do odwołania. Systemy muszą umożliwiać weryfikację decyzji i zapewniać mechanizmy naprawcze, by nie naruszać fundamentalnych praw obywateli. W praktyce oznacza to wdrażanie standardów zgodnych z zasadą transparentność i odpowiedzialność.

Praktyczne rekomendacje i dobre praktyki

Organizacje wdrażające rozwiązania oparte na AI w obszarze prawa powinny przeprowadzać regularne audyty algorytmów, testy na reprezentatywnych danych oraz monitorować wskaźniki błędów i niesprawiedliwości. Audyty zewnętrzne i certyfikacja pomagają zminimalizować ryzyko uprzedzeń.

Kluczowe są też działania na rzecz transparentnośći edukacja użytkowników — zarówno prawników, jak i obywateli. Systemy powinny dostarczać zrozumiałych wyjaśnień swoich rekomendacji oraz umożliwiać interwencję człowieka (nadzór człowieka nad działaniem AI), szczególnie w przypadkach o poważnych konsekwencjach prawnych.

Przykłady zastosowań i narzędzia (w tym LexTool)

W praktyce AI już wspiera prace kancelarii i sądów: narzędzia do analizy dokumentów przyspieszają przegląd akt, systemy do wyszukiwania orzecznictwa polepszają jakość argumentacji, a chatboty pomagają obywatelom w przygotowaniu prostych pism. Takie rozwiązania poprawiają dostępność usług prawnych i obniżają koszty.

Przykładem komercyjnego narzędzia wspierającego pracę prawników jest LexTool — system oferujący analizę dokumentów i wsparcie w przygotowywaniu pism procesowych. Ważne jest, aby podobne narzędzia były wykorzystywane z zachowaniem zasad audytu, dokumentowalności i możliwości odwołania się od rekomendacji generowanych przez AI.

Podsumowanie: równoważenie korzyści i ryzyk

Zarówno szanse, jak i zagrożenia związane z wykorzystaniem AI w dostępie do wymiaru sprawiedliwości są realne i wymagają świadomego zarządzania. Korzyści w postaci szybkości, oszczędności i zwiększonej dostępności muszą iść w parze z mechanizmami ochronnymi: audytami, przejrzystością i jasno określoną odpowiedzialnością.

Polityka publiczna, regulacje i praktyki wdrożeniowe powinny skupić się na tym, by sztuczna inteligencja była narzędziem wspierającym prawo, a nie zastępującym ludzką ocenę w kluczowych sprawach. Tylko wówczas możliwe będzie wykorzystanie pełnego potencjału AI bez naruszania podstawowych zasad praworządności.